Trong bối cảnh cuộc đua trí tuệ nhân tạo toàn cầu đang tiêu tốn hàng tỷ USD vào năng lực tính toán, Baidu, thường được ví như "Google của Trung Quốc", đã tạo nên một cú sốc lớn khi chính thức trình làng mô hình ngôn ngữ lớn ERNIE 5.1.

Điểm gây chú ý nhất không chỉ nằm ở khả năng xử lý vượt trội mà còn ở con số kinh tế đầy ấn tượng: chi phí huấn luyện mô hình này thấp hơn khoảng 94% so với các hệ thống AI cùng quy mô. Đây được xem là một lời giải mới cho bài toán tối ưu hóa nguồn lực trong kỷ nguyên AI thế hệ mới.

Công nghệ nén mạng lưới và chiến lược "đào tạo một lần cho tất cả"

Để hiểu được tại sao Baidu có thể cắt giảm chi phí đến mức khó tin, cần nhìn vào cách thức họ xây dựng ERNIE 5.1.

Thay vì đi theo con đường truyền thống là huấn luyện một mô hình hoàn toàn mới từ con số không, Baidu đã áp dụng phương pháp "huấn luyện sơ bộ đàn hồi đa chiều". Cụ thể, ERNIE 5.1 không phải là một thực thể độc lập hoàn toàn mà được phát triển dựa trên nền tảng của người tiền nhiệm ERNIE 5.0 (ra mắt tháng 1/2026).

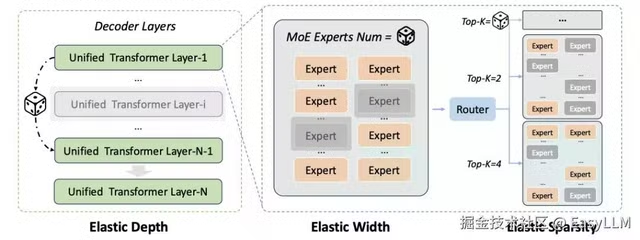

Baidu đã sử dụng khung huấn luyện đàn hồi mang tên "Once-For-All". Thay vì chạy các lượt huấn luyện riêng biệt và đắt đỏ cho từng kích cỡ mô hình khác nhau, công ty này tối ưu hóa cả một "gia đình" các mô hình với nhiều kích thước trong một lần chạy duy nhất.

Các mô hình này chia sẻ trọng số nhưng khác nhau về độ sâu, độ rộng và số lượng các khối chuyên gia (expert blocks) được kích hoạt. Từ kiến trúc khổng lồ của ERNIE 5.0 với khoảng 2.400 tỷ tham số, Baidu đã trích xuất một mạng lưới con được tối ưu hóa để tạo ra ERNIE 5.1.

Kết quả là một mô hình tinh gọn với tổng số tham số chỉ bằng khoảng một phần ba so với bản gốc. Đặc biệt, số lượng tham số hoạt động, tức những phần thực sự tham gia vào việc xử lý phản hồi trong một cuộc hội thoại, đã được cắt giảm một nửa.

Việc kế thừa kho kiến thức đồ sộ từ mô hình "mẹ" mà không cần lặp lại toàn bộ quy trình huấn luyện tốn kém chính là chìa khóa giúp Baidu tiết kiệm được tới 94% ngân sách.

Bên cạnh đó, Baidu cũng tái cấu trúc hoàn toàn hệ thống học tăng cường của mình. Thay vì để các khâu cập nhật mô hình, tạo phản hồi và đánh giá chạy gắn liền với nhau một cách cứng nhắc, họ đã tách chúng thành các phân hệ độc lập, được điều phối bởi một bộ kiểm soát trung tâm.

Điều này cho phép mỗi thành phần được chạy trên phần cứng phù hợp nhất, đảm bảo rằng sự tắc nghẽn ở một bước sẽ không làm chậm toàn bộ quy trình.

Để giải quyết vấn đề sai lệch tính toán trong mô hình hỗn hợp chuyên gia (MoE), Baidu còn triển khai thư viện tính toán độ chính xác thấp tiêu chuẩn hóa, giúp giảm một nửa sự mất ổn định mà không làm giảm tốc độ xử lý.

Giải quyết "hiệu ứng bập bênh" bằng quy trình huấn luyện bốn giai đoạn

Một thách thức cố hữu trong việc huấn luyện các mô hình AI lớn là hiện tượng "hiệu ứng bập bênh" (seesaw effect). Khi các nhà phát triển cố gắng dạy cho AI nhiều kỹ năng cùng một lúc, việc cải thiện năng lực ở mảng này thường dẫn đến sự suy giảm ở mảng khác.

Ví dụ, khi mô hình trở nên giỏi toán hơn, khả năng viết lách sáng tạo của nó có thể bị ảnh hưởng tiêu cực.

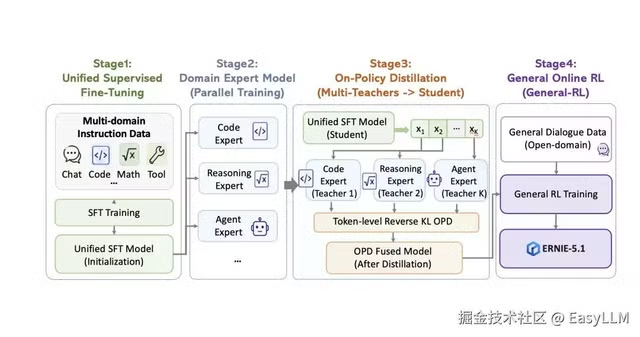

Để khắc phục điều này, Baidu đã thiết lập một quy trình tinh chỉnh gồm bốn giai đoạn mà họ gọi là MOPD (Chưng cất Chính sách Trực tuyến Đa giáo viên - Multi-Teacher On-Policy Distillation).

Giai đoạn đầu tiên bắt đầu với việc huấn luyện có giám sát tiêu chuẩn trên một tập dữ liệu rộng lớn.

Bước sang giai đoạn thứ hai, Baidu huấn luyện song song nhiều mô hình chuyên gia riêng biệt cho các lĩnh vực như lập trình, suy luận logic và các tác vụ đại lý (agent), mỗi mô hình có các tín hiệu đánh giá riêng.

Đến giai đoạn thứ ba, một mô hình "học sinh" duy nhất sẽ học cùng lúc từ tất cả các "giáo viên" chuyên gia này bằng cách tự tạo ra câu trả lời và so sánh chúng với kết quả của các chuyên gia.

Giai đoạn cuối cùng là học tăng cường tổng quát cho các cuộc đối thoại mở và tác vụ sáng tạo.

Theo Baidu, bước cuối này là tối quan trọng vì quá trình chưng cất từ giáo viên sang học sinh đôi khi tạo ra những câu trả lời quá trau chuốt nhưng thiếu đi sự đa dạng.

Nhờ quy trình này, ERNIE 5.1 đạt được sự cân bằng về trình độ giữa các kỹ năng, không để bất kỳ lĩnh vực nào bị ưu tiên quá mức dẫn đến lấn át các kỹ năng khác.

Hiệu năng dẫn đầu và tham vọng chiếm lĩnh thị trường toàn cầu

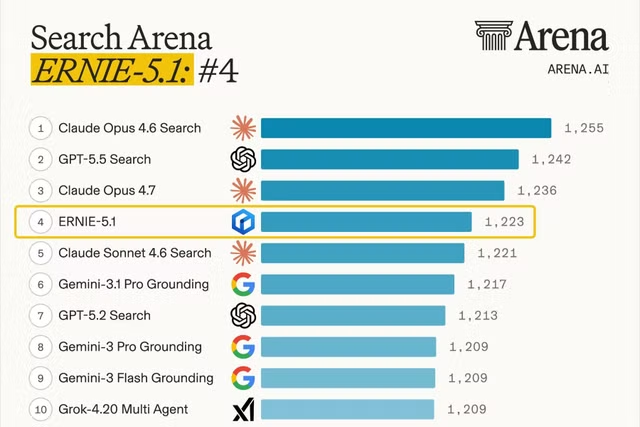

Những nỗ lực tối ưu hóa của Baidu đã mang lại kết quả cụ thể trên các bảng xếp hạng uy tín. Trên LMArena Search Arena, nơi các mô hình AI được người dùng thực tế chấm điểm thông qua các tác vụ tìm kiếm web trực tiếp, ERNIE 5.1 đã đạt 1.223 điểm tính đến ngày 9/5.

Điểm số này giúp nó đứng vị trí thứ 4 toàn cầu và giữ vị trí quán quân trong số tất cả các mô hình do Trung Quốc phát triển.

Trong các bài kiểm tra chuyên sâu về kiến thức và suy luận, ERNIE 5.1 đã tiệm cận hiệu suất của các mô hình mã nguồn đóng hàng đầu phương Tây như Gemini 3.1 Pro của Google.

Tại kỳ thi toán học AIME26, mô hình này đạt tỷ lệ chính xác 99,6% khi sử dụng các công cụ hỗ trợ suy luận, chỉ đứng sau duy nhất Gemini 3.1 Pro.

Đặc biệt, trong các tác vụ liên quan đến "khả năng đại lý" như xử lý bảng tính phức tạp hay tự động duyệt web đa bước, ERNIE 5.1 đã vượt qua DeepSeek-V4-Pro – mô hình từng giữ kỷ lục tại Trung Quốc.

Câu chuyện về hiệu quả của ERNIE 5.1 gợi nhớ đến sức ảnh hưởng của DeepSeek R1 vào đầu năm 2025, khi startup này chứng minh rằng có thể đạt hiệu suất tương đương OpenAI o1 với chi phí thấp hơn 98%.

Tuy nhiên, trong khi DeepSeek tập trung vào hiệu quả suy luận, ERNIE 5.1 lại tạo ra bước đột phá ngay từ khâu huấn luyện sơ bộ.

Thông điệp mà Baidu gửi đi rất rõ ràng: các phòng thí nghiệm AI Trung Quốc đang liên tục tìm ra những phương thức sáng tạo để "làm được nhiều hơn với ít nguồn lực hơn", thay vì chỉ dựa vào việc đổ thêm sức mạnh phần cứng.

Hiện tại, ERNIE 5.1 đã bắt đầu được triển khai rộng rãi trên hơn 10 nền tảng sáng tạo và đại lý tại Trung Quốc. Người dùng có thể trải nghiệm mô hình này qua các ứng dụng như nền tảng nhập vai Isekai Zero, công cụ tạo phim ngắn Storymaster, hay ứng dụng đồ họa Diting Huanliu.

![[INFOGRAPHIC] SoundPEATS Air5 Pro+, Tai nghe “nhét” công nghệ flagship](https://vndl-cdn.kienthuc.net.vn/images/dfc4fe9cc2cc4b148e7aee274a477338e00f5e274bf18428fdea451cbdb8884c08408a1259eb6e33bc3b04c5558c9048bc2eb26214da595fe35f396e6543113f/thumb-tai-nghe-11-5.jpg.avif)